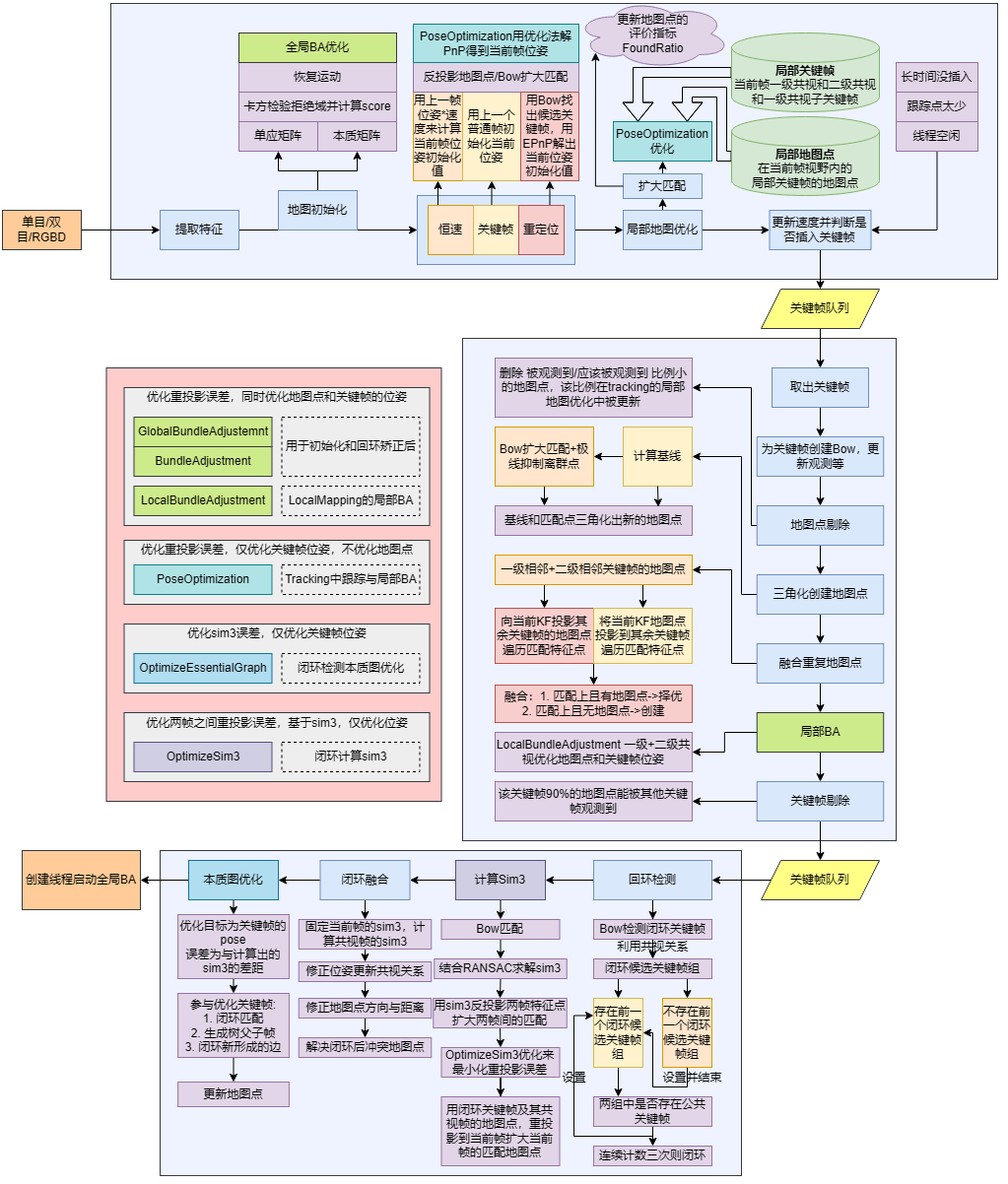

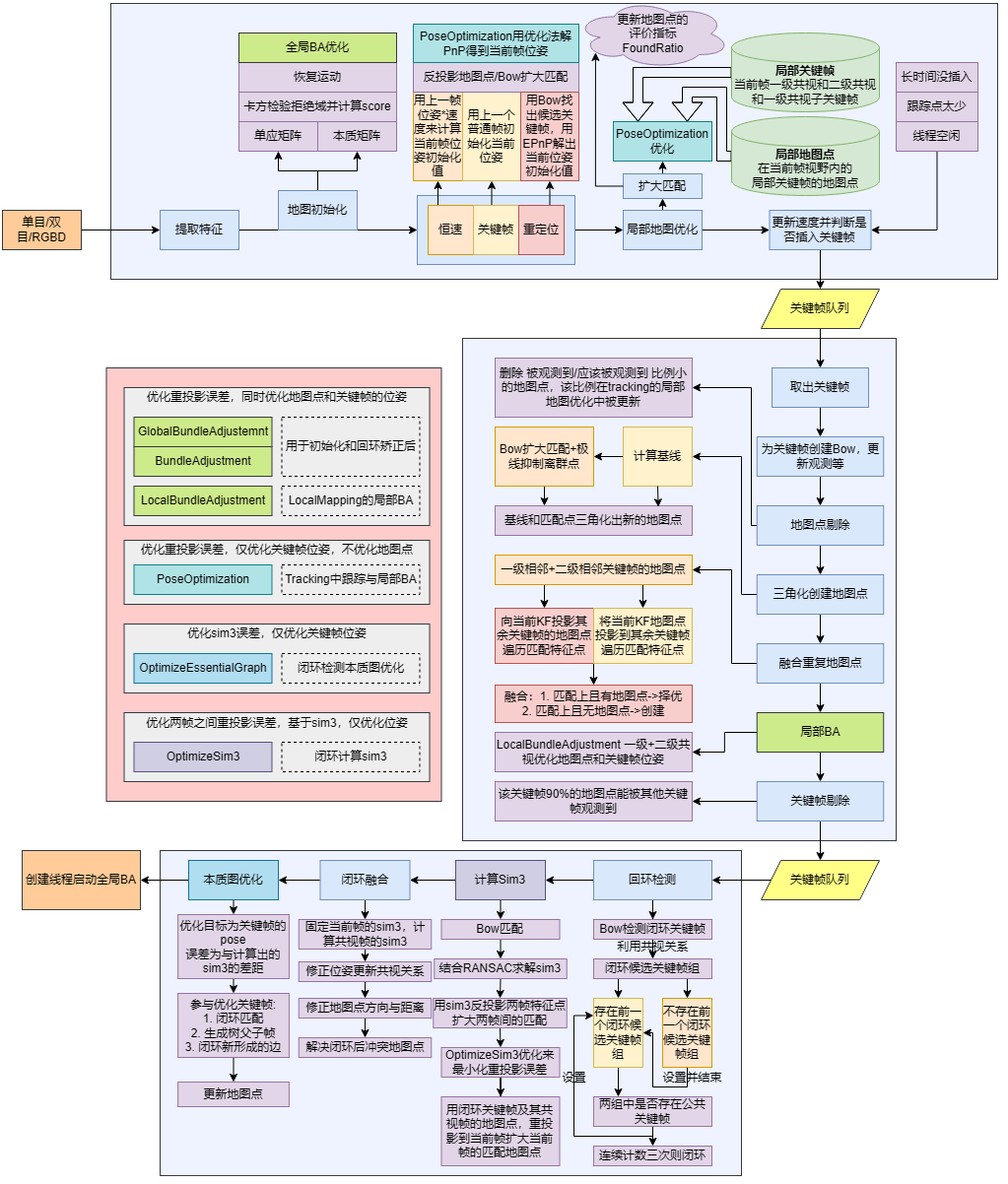

ORBSLAM2的建图器LocalMapping

建图器LocalMapping

LocalMapping的所有输入都是关键帧,从一个列表中不断pop出由Tracking送进来的关键帧,然后逐步执行下列操作:

- 为关键帧更新观测、创建Bow等初始化关键的操作

- 通过Tracking中统计的相关指标来剔除不好的地图点

- 当前关键帧与相邻关键帧通过三角化产生新的地图点,使得跟踪更稳

- 检查并融合当前关键帧与相邻关键帧帧(两级相邻)中重复的地图点

- 局部地图BA

- 检测并剔除当前帧相邻的关键帧中冗余的关键帧

LocalMapping里的每个模块都是互相独立的,而且步骤也都很简单,因此就不画图了,文字描述一下就好了。

初始化关键帧

这里主要负责计算对刚刚送进来的关键帧初始化,因为通过普通帧创建的关键帧只保留了特征点和位姿的信息,其余的比如词袋、地图点的观测(地图点的平均方向要用关键帧来算)和共视关系之类的数据统统没有,因此这一步主要就是计算这些信息。

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

|

void LocalMapping::ProcessNewKeyFrame()

{

...

mpCurrentKeyFrame->ComputeBoW();

const vector<MapPoint *> vpMapPointMatches = mpCurrentKeyFrame->GetMapPointMatches();

for (size_t i = 0; i < vpMapPointMatches.size(); i++)

{

MapPoint *pMP = vpMapPointMatches[i];

if (pMP)

{

if (!pMP->isBad())

{

if (!pMP->IsInKeyFrame(mpCurrentKeyFrame))

{

pMP->AddObservation(mpCurrentKeyFrame, i);

pMP->UpdateNormalAndDepth();

pMP->ComputeDistinctiveDescriptors();

}

else

{

mlpRecentAddedMapPoints.push_back(pMP);

}

}

}

}

mpCurrentKeyFrame->UpdateConnections();

mpMap->AddKeyFrame(mpCurrentKeyFrame);

}

|

剔除不好的地图点

剔除以下两种地图点:

- 跟踪到该地图点的帧数相比预计可观测到该地图点的帧数的比例小于25%,即Tracking中计算的mnFound和mnVisible

- 该地图点创立时间超过2个关键帧,但是观测到该点的普通帧数目不超过阈值

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

|

void LocalMapping::MapPointCulling()

{

...

while (lit != mlpRecentAddedMapPoints.end())

{

MapPoint *pMP = *lit;

if (pMP->isBad())

{

lit = mlpRecentAddedMapPoints.erase(lit);

}

else if (pMP->GetFoundRatio() < 0.25f)

{

pMP->SetBadFlag();

lit = mlpRecentAddedMapPoints.erase(lit);

}

else if (((int)nCurrentKFid - (int)pMP->mnFirstKFid) >= 2 && pMP->Observations() <= cnThObs)

{

pMP->SetBadFlag();

lit = mlpRecentAddedMapPoints.erase(lit);

}

else if (((int)nCurrentKFid - (int)pMP->mnFirstKFid) >= 3)

lit = mlpRecentAddedMapPoints.erase(lit);

else

lit++;

}

}

|

三角化创建新的地图点

用当前关键帧与共视关键帧通过三角化产生新的地图点,使得跟踪更稳定,具体而言:

- 首先找到当前关键帧共视关系最好的前n个共视关键帧

- 遍历n个共视关键帧,通过计算相机光心距离来判断基线距离,删除掉基线过短的共视关键帧

- 在剩余共视关键帧中计算基础矩阵,通过Bow快速匹配并用极线抑制离群点来生成匹配点对

- 三角化并校验重投影误差是否满足卡方检验,同时还会保证深度为正

- 最后会检查尺度一致性,地图点到两帧的深度的比值应该是对应特征点在两帧中金字塔层级的比值近似一致

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

78

79

80

81

82

83

84

85

86

87

88

89

90

91

92

93

94

95

96

97

98

99

100

101

102

103

104

105

106

107

108

109

110

111

112

113

114

115

116

117

118

119

120

121

122

123

124

125

126

127

128

129

130

131

132

133

134

135

136

137

138

139

140

141

142

143

144

145

146

147

148

149

150

151

152

153

154

155

156

157

158

159

160

161

162

163

164

165

166

167

168

169

170

171

172

173

|

void LocalMapping::CreateNewMapPoints()

{

int nn = 10;

if (mbMonocular)

nn = 20;

const vector<KeyFrame *> vpNeighKFs = mpCurrentKeyFrame->GetBestCovisibilityKeyFrames(nn);

...

int nnew = 0;

for (size_t i = 0; i < vpNeighKFs.size(); i++)

{

...

cv::Mat vBaseline = Ow2 - Ow1;

const float baseline = cv::norm(vBaseline);

if (!mbMonocular)

{

if (baseline < pKF2->mb)

continue;

}

else

{

const float medianDepthKF2 = pKF2->ComputeSceneMedianDepth(2);

const float ratioBaselineDepth = baseline / medianDepthKF2;

if (ratioBaselineDepth < 0.01)

continue;

}

cv::Mat F12 = ComputeF12(mpCurrentKeyFrame, pKF2);

vector<pair<size_t, size_t>> vMatchedIndices;

matcher.SearchForTriangulation(mpCurrentKeyFrame, pKF2, F12, vMatchedIndices, false);

...

const int nmatches = vMatchedIndices.size();

for (int ikp = 0; ikp < nmatches; ikp++)

{

...

cv::Mat x3D;

if (cosParallaxRays < cosParallaxStereo && cosParallaxRays > 0 && (bStereo1 || bStereo2 || cosParallaxRays < 0.9998))

{

cv::Mat A(4, 4, CV_32F);

A.row(0) = xn1.at<float>(0) * Tcw1.row(2) - Tcw1.row(0);

A.row(1) = xn1.at<float>(1) * Tcw1.row(2) - Tcw1.row(1);

A.row(2) = xn2.at<float>(0) * Tcw2.row(2) - Tcw2.row(0);

A.row(3) = xn2.at<float>(1) * Tcw2.row(2) - Tcw2.row(1);

cv::Mat w, u, vt;

cv::SVD::compute(A, w, u, vt, cv::SVD::MODIFY_A | cv::SVD::FULL_UV);

x3D = vt.row(3).t();

if (x3D.at<float>(3) == 0)

continue;

x3D = x3D.rowRange(0, 3) / x3D.at<float>(3);

}

else if (bStereo1 && cosParallaxStereo1 < cosParallaxStereo2)

{

x3D = mpCurrentKeyFrame->UnprojectStereo(idx1);

}

else if (bStereo2 && cosParallaxStereo2 < cosParallaxStereo1)

{

x3D = pKF2->UnprojectStereo(idx2);

}

else

continue;

...

float z1 = Rcw1.row(2).dot(x3Dt) + tcw1.at<float>(2);

if (z1 <= 0)

continue;

float z2 = Rcw2.row(2).dot(x3Dt) + tcw2.at<float>(2);

if (z2 <= 0)

continue;

const float &sigmaSquare1 = mpCurrentKeyFrame->mvLevelSigma2[kp1.octave];

const float x1 = Rcw1.row(0).dot(x3Dt) + tcw1.at<float>(0);

const float y1 = Rcw1.row(1).dot(x3Dt) + tcw1.at<float>(1);

const float invz1 = 1.0 / z1;

if (!bStereo1)

{

float u1 = fx1 * x1 * invz1 + cx1;

float v1 = fy1 * y1 * invz1 + cy1;

float errX1 = u1 - kp1.pt.x;

float errY1 = v1 - kp1.pt.y;

if ((errX1 * errX1 + errY1 * errY1) > 5.991 * sigmaSquare1)

continue;

}

else

{

float u1 = fx1 * x1 * invz1 + cx1;

float u1_r = u1 - mpCurrentKeyFrame->mbf * invz1;

float v1 = fy1 * y1 * invz1 + cy1;

float errX1 = u1 - kp1.pt.x;

float errY1 = v1 - kp1.pt.y;

float errX1_r = u1_r - kp1_ur;

if ((errX1 * errX1 + errY1 * errY1 + errX1_r * errX1_r) > 7.8 * sigmaSquare1)

continue;

}

...

cv::Mat normal1 = x3D - Ow1;

float dist1 = cv::norm(normal1);

cv::Mat normal2 = x3D - Ow2;

float dist2 = cv::norm(normal2);

if (dist1 == 0 || dist2 == 0)

continue;

const float ratioDist = dist2 / dist1;

const float ratioOctave = mpCurrentKeyFrame->mvScaleFactors[kp1.octave] / pKF2->mvScaleFactors[kp2.octave];

if (ratioDist * ratioFactor < ratioOctave || ratioDist > ratioOctave * ratioFactor)

continue;

...

mlpRecentAddedMapPoints.push_back(pMP);

nnew++;

}

}

}

|

融合重复地图点

由于物理上同一个点可能被不同帧观测到从而被认成多个地图点,所以需要不断去融合这些重复的地图点来保证建图本身是准确的,具体而言:

- 首先找到当前关键帧共视关系最好的前n个一级共视关键帧

- 再找每个一级共视关键帧中共视最好的前5个二级共视关键帧

- 记录下这些一级共视和二级共视关键帧,作为待融合的关键帧

- 将当前关键帧的地图点投影到上述关键帧中,使用前文提到的

ORBmatcher::Fuse来进行融合

- 将上述关键帧的地图点投影到当前关键帧中,使用前文提到的

ORBmatcher::Fuse来进行融合

- 更新地图点的描述子、深度、观测方向等信息

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

|

void LocalMapping::SearchInNeighbors()

{

...

vector<MapPoint *> vpMapPointMatches = mpCurrentKeyFrame->GetMapPointMatches();

for (vector<KeyFrame *>::iterator vit = vpTargetKFs.begin(), vend = vpTargetKFs.end(); vit != vend; vit++)

{

KeyFrame *pKFi = *vit;

matcher.Fuse(pKFi, vpMapPointMatches);

}

vector<MapPoint *> vpFuseCandidates;

vpFuseCandidates.reserve(vpTargetKFs.size() * vpMapPointMatches.size());

for (vector<KeyFrame *>::iterator vitKF = vpTargetKFs.begin(), vendKF = vpTargetKFs.end(); vitKF != vendKF; vitKF++)

{

KeyFrame *pKFi = *vitKF;

vector<MapPoint *> vpMapPointsKFi = pKFi->GetMapPointMatches();

for (vector<MapPoint *>::iterator vitMP = vpMapPointsKFi.begin(), vendMP = vpMapPointsKFi.end(); vitMP != vendMP; vitMP++)

{

MapPoint *pMP = *vitMP;

if (!pMP)

continue;

if (pMP->isBad() || pMP->mnFuseCandidateForKF == mpCurrentKeyFrame->mnId)

continue;

pMP->mnFuseCandidateForKF = mpCurrentKeyFrame->mnId;

vpFuseCandidates.push_back(pMP);

}

}

matcher.Fuse(mpCurrentKeyFrame, vpFuseCandidates);

vpMapPointMatches = mpCurrentKeyFrame->GetMapPointMatches();

for (size_t i = 0, iend = vpMapPointMatches.size(); i < iend; i++)

{

MapPoint *pMP = vpMapPointMatches[i];

if (pMP)

{

if (!pMP->isBad())

{

pMP->ComputeDistinctiveDescriptors();

pMP->UpdateNormalAndDepth();

}

}

}

mpCurrentKeyFrame->UpdateConnections();

}

|

局部BA

LocalMapping中的局部BA不要跟Tracking中的局部地图优化弄混了,Tracking中的局部地图优化只优化一个普通帧的位姿,不优化地图点;而LocalMapping中的局部BA直接调用Optimizer::LocalBundleAdjustment函数,这个函数会优化多个关键帧以及相应地图点的位姿。

- 首先找到当前关键帧的一级共视关键帧和对应的地图点

- 通过地图点找到二级共视关键帧

- 构建重投影误差优化,其中当前关键帧、一级共视关键帧和地图点是待优化变量;二级共视关键帧的位姿不会被优化

- 第一阶段优化会使用卡方检验剔除外点

- 第二阶段优化会使用内点求精

- 剔除掉误差比较大地图点的观测,并更新关键帧与地图点的各种信息(观测方向等等)

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

78

79

80

81

82

83

84

85

86

87

88

89

90

91

92

93

94

95

96

97

98

99

100

101

102

103

104

105

106

107

108

109

110

111

112

113

114

115

116

117

118

119

120

121

122

123

124

125

126

127

128

129

130

131

132

133

134

135

136

137

138

139

140

141

142

143

144

145

146

147

148

149

150

151

152

153

154

155

156

157

158

159

160

161

162

163

164

165

166

167

168

169

170

171

172

173

174

175

176

177

178

179

180

181

182

183

184

185

186

187

188

189

190

191

192

193

194

195

196

197

198

199

200

201

202

203

204

205

206

207

208

209

210

211

212

213

214

215

216

217

218

219

220

221

222

223

224

225

226

227

228

229

230

231

232

233

234

235

236

|

void Optimizer::LocalBundleAdjustment(KeyFrame *pKF, bool *pbStopFlag, Map *pMap)

{

...

...

for (list<KeyFrame *>::iterator lit = lLocalKeyFrames.begin(), lend = lLocalKeyFrames.end(); lit != lend; lit++)

{

KeyFrame *pKFi = *lit;

g2o::VertexSE3Expmap *vSE3 = new g2o::VertexSE3Expmap();

vSE3->setEstimate(Converter::toSE3Quat(pKFi->GetPose()));

vSE3->setId(pKFi->mnId);

vSE3->setFixed(pKFi->mnId == 0);

optimizer.addVertex(vSE3);

if (pKFi->mnId > maxKFid)

maxKFid = pKFi->mnId;

}

for (list<KeyFrame *>::iterator lit = lFixedCameras.begin(), lend = lFixedCameras.end(); lit != lend; lit++)

{

KeyFrame *pKFi = *lit;

g2o::VertexSE3Expmap *vSE3 = new g2o::VertexSE3Expmap();

vSE3->setEstimate(Converter::toSE3Quat(pKFi->GetPose()));

vSE3->setId(pKFi->mnId);

vSE3->setFixed(true);

optimizer.addVertex(vSE3);

if (pKFi->mnId > maxKFid)

maxKFid = pKFi->mnId;

}

...

const float thHuberMono = sqrt(5.991);

const float thHuberStereo = sqrt(7.815);

for (list<MapPoint *>::iterator lit = lLocalMapPoints.begin(), lend = lLocalMapPoints.end(); lit != lend; lit++)

{

MapPoint *pMP = *lit;

g2o::VertexSBAPointXYZ *vPoint = new g2o::VertexSBAPointXYZ();

vPoint->setEstimate(Converter::toVector3d(pMP->GetWorldPos()));

int id = pMP->mnId + maxKFid + 1;

vPoint->setId(id);

vPoint->setMarginalized(true);

optimizer.addVertex(vPoint);

const map<KeyFrame *, size_t> observations = pMP->GetObservations();

for (map<KeyFrame *, size_t>::const_iterator mit = observations.begin(), mend = observations.end(); mit != mend; mit++)

{

KeyFrame *pKFi = mit->first;

if (!pKFi->isBad())

{

const cv::KeyPoint &kpUn = pKFi->mvKeysUn[mit->second];

if (pKFi->mvuRight[mit->second] < 0)

{

Eigen::Matrix<double, 2, 1> obs;

obs << kpUn.pt.x, kpUn.pt.y;

g2o::EdgeSE3ProjectXYZ *e = new g2o::EdgeSE3ProjectXYZ();

e->setVertex(0, dynamic_cast<g2o::OptimizableGraph::Vertex *>(optimizer.vertex(id)));

e->setVertex(1, dynamic_cast<g2o::OptimizableGraph::Vertex *>(optimizer.vertex(pKFi->mnId)));

e->setMeasurement(obs);

const float &invSigma2 = pKFi->mvInvLevelSigma2[kpUn.octave];

e->setInformation(Eigen::Matrix2d::Identity() * invSigma2);

g2o::RobustKernelHuber *rk = new g2o::RobustKernelHuber;

e->setRobustKernel(rk);

rk->setDelta(thHuberMono);

e->fx = pKFi->fx;

e->fy = pKFi->fy;

e->cx = pKFi->cx;

e->cy = pKFi->cy;

optimizer.addEdge(e);

vpEdgesMono.push_back(e);

vpEdgeKFMono.push_back(pKFi);

vpMapPointEdgeMono.push_back(pMP);

}

else

{

...

}

}

}

}

...

optimizer.initializeOptimization();

optimizer.optimize(5);

...

if (bDoMore)

{

for (size_t i = 0, iend = vpEdgesMono.size(); i < iend; i++)

{

g2o::EdgeSE3ProjectXYZ *e = vpEdgesMono[i];

MapPoint *pMP = vpMapPointEdgeMono[i];

if (pMP->isBad())

continue;

if (e->chi2() > 5.991 || !e->isDepthPositive())

{

e->setLevel(1);

}

e->setRobustKernel(0);

}

...

optimizer.initializeOptimization(0);

optimizer.optimize(10);

}

vector<pair<KeyFrame *, MapPoint *>> vToErase;

vToErase.reserve(vpEdgesMono.size() + vpEdgesStereo.size());

for (size_t i = 0, iend = vpEdgesMono.size(); i < iend; i++)

{

g2o::EdgeSE3ProjectXYZ *e = vpEdgesMono[i];

MapPoint *pMP = vpMapPointEdgeMono[i];

if (pMP->isBad())

continue;

if (e->chi2() > 5.991 || !e->isDepthPositive())

{

KeyFrame *pKFi = vpEdgeKFMono[i];

vToErase.push_back(make_pair(pKFi, pMP));

}

}

...

if (!vToErase.empty())

{

for (size_t i = 0; i < vToErase.size(); i++)

{

KeyFrame *pKFi = vToErase[i].first;

MapPoint *pMPi = vToErase[i].second;

pKFi->EraseMapPointMatch(pMPi);

pMPi->EraseObservation(pKFi);

}

}

for (list<KeyFrame *>::iterator lit = lLocalKeyFrames.begin(), lend = lLocalKeyFrames.end(); lit != lend; lit++)

{

KeyFrame *pKF = *lit;

g2o::VertexSE3Expmap *vSE3 = static_cast<g2o::VertexSE3Expmap *>(optimizer.vertex(pKF->mnId));

g2o::SE3Quat SE3quat = vSE3->estimate();

pKF->SetPose(Converter::toCvMat(SE3quat));

}

for (list<MapPoint *>::iterator lit = lLocalMapPoints.begin(), lend = lLocalMapPoints.end(); lit != lend; lit++)

{

MapPoint *pMP = *lit;

g2o::VertexSBAPointXYZ *vPoint = static_cast<g2o::VertexSBAPointXYZ *>(optimizer.vertex(pMP->mnId + maxKFid + 1));

pMP->SetWorldPos(Converter::toCvMat(vPoint->estimate()));

pMP->UpdateNormalAndDepth();

}

}

|

剔除不好的关键帧

关键帧的剔除也是非常简单的,剔除标准只有一个:当前关键帧的90%以上的地图点能被其他关键帧(至少3个)观测到

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

78

79

80

81

82

83

|

void LocalMapping::KeyFrameCulling()

{

vector<KeyFrame *> vpLocalKeyFrames = mpCurrentKeyFrame->GetVectorCovisibleKeyFrames();

for (vector<KeyFrame *>::iterator vit = vpLocalKeyFrames.begin(), vend = vpLocalKeyFrames.end(); vit != vend; vit++)

{

KeyFrame *pKF = *vit;

if (pKF->mnId == 0)

continue;

const vector<MapPoint *> vpMapPoints = pKF->GetMapPointMatches();

int nObs = 3;

const int thObs = nObs;

int nRedundantObservations = 0;

int nMPs = 0;

for (size_t i = 0, iend = vpMapPoints.size(); i < iend; i++)

{

MapPoint *pMP = vpMapPoints[i];

if (pMP)

{

if (!pMP->isBad())

{

if (!mbMonocular)

{

if (pKF->mvDepth[i] > pKF->mThDepth || pKF->mvDepth[i] < 0)

continue;

}

nMPs++;

if (pMP->Observations() > thObs)

{

const int &scaleLevel = pKF->mvKeysUn[i].octave;

const map<KeyFrame *, size_t> observations = pMP->GetObservations();

int nObs = 0;

for (map<KeyFrame *, size_t>::const_iterator mit = observations.begin(), mend = observations.end(); mit != mend; mit++)

{

KeyFrame *pKFi = mit->first;

if (pKFi == pKF)

continue;

const int &scaleLeveli = pKFi->mvKeysUn[mit->second].octave;

if (scaleLeveli <= scaleLevel + 1)

{

nObs++;

if (nObs >= thObs)

break;

}

}

if (nObs >= thObs)

{

nRedundantObservations++;

}

}

}

}

}

if (nRedundantObservations > 0.9 * nMPs)

pKF->SetBadFlag();

}

}

|